豆包 Seed 2.0 Lite升级:给 Agent 装上眼睛和耳朵

全文阅读

以下为编辑整理后的完整富文本内容。

豆包 Seed 2.0 Lite升级:给 Agent 装上眼睛和耳朵

最近一个月模型发布太卷了。Claude Opus 4.7、GPT-5.5、DeepSeek V4 一个接一个,我每天打开 X 都觉得自己快被新模型淹没。光是我自己,前几周就赶着做了三期 B 站视频去解读这些发布。

录过视频的人应该有体会,做视频最痛苦的环节之一,是剪字幕。

我录视频从来不按脚本念。

相比看着脚本读稿,我通常还是更喜欢自由随性点讲,会显得更有认为。然后遇到的情况就是:专业术语念一半改口、数字换种说法、想到一个例子塞进去,这是我录视频的常态。然后剪辑的第一步永远是上字幕,丢进剪辑软件自动识别,再花一个钟头改回来。

我特别讨厌这个环节。倒不是麻烦。每次看到字幕里那一堆识别错位的术语,我都会有点恍惚,总觉得有种说我普通话、英语发音不标准的弹幕在坏坏的飘过。

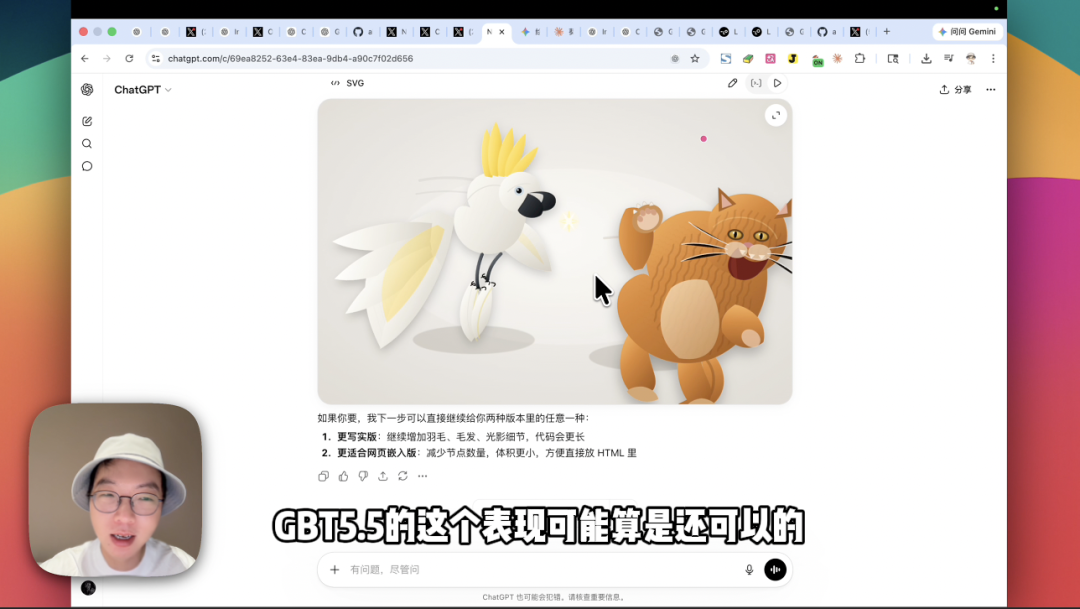

需要改写什么呢?「Claude Opus 4.7」被听成「Claude 四点七」,「Codex」被切成「Code X」,「GPT-5.5」变成「GBT 5.5」。

这些都还好,最离谱的一次:上周我录了一段介绍我自己开源的 huashu-design skill,自动字幕给我转出来一行字「 花书 Diffusion 」。

它完全把 Huashu Design 重新解析成了一个根本不存在的 AI 模型。下面这种错误都算客气了。

我研究了一下原因。这是语音识别工具通用的工作方式:它在听音频的时候不知道我在录什么,没有上下文,于是在所有可能的同音组合里挑一个它最熟悉的。「huashu-design」这种组合从来没在它训练数据里出现过。

这件事困扰我至少三年。每次写完脚本我都会想:要是录之前能跟模型说一声「我接下来要讲 Codex、Claude Opus 4.7、Hermes Agent,huashu-design 是我自己的开源项目」,它会不会就不犯这种错?

我说一下我的工作台。我大部分时间在 Claude Code 等Coding Agent里干活,写文章、改代码、做调研、整理素材都在它里面。它对我的意义是:绝大多数任务都应该在这个工作台内自动化完成,少跳出去用别的工具,少切换上下文。

但 Claude Code 这个工作台里没有原生的音视频通道。我录的 B 站视频丢不进去(即便丢进去也只能截图分析),会议录音根本没法直接处理,别人家的产品发布动画也得手动转写。它在文字这一层非常强,在「眼睛+耳朵」这一层基本是空的。我每次想把视频或者音频变成可以处理的文本,都得跳出工作台,去用别的工具,再把结果粘回来。而这个跳出去的环节,就是「花书 Diffusion」翻车的地方。

这事儿其实不是字幕工具一家的问题。你看国内大模型公司最近这半年的发布节奏就明白了,几乎所有家都跟着 Anthropic 把 coding 和 agentic 卷到极致,多模态放在了相对靠后的位置。

我能理解这个选择。coding 和 agentic 确实是模型最高价值的方向,也是模型公司之间分胜负的地方。但 做内容这一行,经常会卡住的反而是多模态 :要看竞品视频是怎么剪的、要把会议录音整理成纪要、要给自己的视频做精准字幕、要从一段长视频里捞出 3 个关键片段。这些事 LLM 本身解决不了,每次都要跳出工作台,找一个语音识别工具、一个抽帧脚本、一个胶水流程拼起来。

最近在火山引擎看到字节方舟发了 豆包 Seed 2.0 Lite (0428版)。看到价格这超低的价格有点心动,然后,正好启发了几种新的工作流灵感~

它在原来 02 月 Lite 版的基础上做了一件事: 这次 Lite 也能听了 。原来的 Lite 已经能看图、能读视频、能处理文字,这次把听觉补上了。是真的「听」,不只是把声音转成文字,连情绪、环境声、多说话人都能一起捕捉。

以及有个特别值得强调的点是,别一看「全模态」就以为它跟普通图像理解模型差不多。 它是能直接读视频的 ,不是只能看一帧静态图。你扔一段 60 秒的视频进去,它能告诉你画面节奏、字体风格、动效转场、音视频是否一致,这件事 GPT-5.5、Claude Opus 4.7 都做不到。御三家里暂时只有Gemini做了这项能力,但是他们实在是特么有点贵了,没那么实用。

以及,甚至从性能表现来说,最新的Seed 2.0 Lite不止超过了前一代的Seed 2.0 Pro的视觉理解能力,甚至在多个维度上都达到了SOTA级别👇

所以严格来说,它给 Agent 装上的不只是耳朵,还是一双能读视频的眼睛。我接下来会用两个 demo 把这两件事都跑一遍。

而且关键点在这里:豆包 Seed 2.0 Lite 的调用方式跟你调任何一个大模型 API 没区别。这意味着你可以在 prompt 里告诉它你接下来要听的是什么。

我把那段录有「huashu-design」的音频丢给它,附上一个 1900 字的 prompt:录制背景、说话人风格、46 个易错术语清单(GPT-5.5、Claude Opus 4.7、Codex、Anthropic、Apollo Research……)。让它输出标准 SRT 字幕。

然后我把同一段音频也丢进剪辑软件自动字幕——剪辑软件是大多数人做视频的默认选择,对比它最直观。结果:

剪辑软件这边把 GitHub 听成了 GitLab、Claude Opus 4.7 变 COS4.7、GPT-5.5 变 GBT5.5、Claude 4.7 变 cloud 4.7、huashu-design 变花书design——这不是剪辑软件烂,是所有自动字幕工具的通病: 没有上下文,模型只能在同音组合里挑它最熟的那个 。平时会拍视频的同学应该懂我在说什么。

豆包这边呢? 全对 。huashu-design、Claude Opus 4.7、GPT-5.5、GitHub、Claude 4.7,一个不错。

但这里要补一个 best practice,不然你照着去试可能会失望: 豆包不写 prompt 直接跑,效果只比剪辑软件好一点 ——还是会把一部分专有名词识别歪。它真正的能力,是你把背景、术语清单、说话人风格都写进 prompt 之后才解锁的。这次升级真正解锁的不是「模型能听」,是「 模型能在你给的上下文里听 」。

所以如果你要把它塞进生产链路,prompt 上下文是必须做的功课。少了这一步,全模态的能力就发挥不出来。

更出乎意料的是成本。一段 277 秒的音频,加了 1900 字 prompt 反而比不加便宜——prompt token 多了 1208 个,但模型不用瞎猜了,输出 token 少了 763 个。 总成本下降 20% ,单次不到一分钱。

事情到这里其实没完,因为「带上下文做字幕」只是这次0428升级最浅的一层。我接下来连做了两个 demo,一个是用它去看另一支 AI 的产品发布动画,一个是验证它在真实工作流里的位置。也就是这篇文章真正想说的那件事:

这一代 Agent 工具,不管是 Claude Code、Cursor 还是 OpenClaw,一直缺一双能听音频、能看视频的耳朵和眼睛。豆包 Seed 2.0 Lite 0428 非常难得给补上了,价格还很实惠。

Focus让 AI 看另一支 AI 的产品视频

字幕这条线我跑通之后,做了第二个实验,更狠一点。因为我发现Seed 2.0 Lite模型在视频理解能力上有点猛,机会是全方面碾压Gemini-3-Pro的水平👇

OpenAI 上周在 X 上发 GPT-5.5 的时候配了一支 55 秒的 hero 动画:白底、Inter 字体、打字机标题、4 段产品演示(解魔方、跨 Slack 修 bug、生成财务 PPT、blossom logo 收尾)。

这种动画是产品发布的标准品,我自己做过几次,每次都得拉竞品视频反复看,写一份给前端的 brief,再过一遍设计稿。整个链路三天起步。

先看看 OpenAI 那段原视频长什么样:

我把这支 55 秒视频直接喂给豆包 Seed 2.0 Lite,写了一份 prompt:你看完这个视频,按 8 个维度(节奏、视觉系统、动效转场、文案策略、品牌资产、音频、镜头、迁移建议)给我一份结构化输出,最后给我一份「豆包 Seed 2.0 Lite 发布动画」的分镜表,要具体到颜色 hex、字号、动效时序,让前端能直接动手。

它真给了。

视频里几乎所有可观测的细节它都识别到了:5 段时间码(0-4s 标题、5-13s 解魔方、14-34s Slack 修 bug、35-50s 生成 PPT、51-55s logo 收尾)、字体气质(Inter 类无衬线、字重 700/400/500 三层)、强调色 #A855F7 紫、blossom 花形符号在魔方表面和结尾出现两次、BPM 估值 80-90、平均切换频率 3.5 秒。它还顺手指出了开场前 3 秒的钩子结构和结尾 3 秒的品牌定格逻辑。

更有用的是 H 部分。它给我写了一份可执行的分镜表:7 段、每段时间码、画面元素、文案、动效、要用的数据点。我把这份表又过了一遍,把它默认套用 OpenAI 紫色那部分换成火山方舟自己的品牌色( #006EFF / #00E5E5 ),把 5-13s 那段「全模态感官可视化」具象化(左侧波形图、中间豆包 logo 脉冲、右侧抽帧缩略图三栏汇聚),加了 SFX 节拍和字体规范,整成一份最终蓝本。

然后这份蓝本交给我自己另一个 skill huashu-design (专门做 HTML 动画的),让它按蓝本写代码、Playwright 录屏、ffmpeg 出 MP4。最后产出长这样:

整个链路从看视频到拿到 MP4,没有人写一份 brief。

我以前做产品视频是这样的:看 5 个竞品 → 写 8 千字 brief → 找设计师 → 改 3 轮。现在变成:把 1 个竞品丢进 LLM → LLM 写 brief → 另一个 LLM 写代码出动画。中间那 8 千字的 brief,是这次升级里第一个被吃掉的环节。

这个 demo 不是为了证明豆包能做视频,它做不了,它只是看懂了视频。让 AI 看视频这件事的价值,是把「拆解参考」这道工序从手动变成 API 调用。

Focus数据对比:同一段音频,两个 prompt

回到字幕那条线,我把对比数据完整列一下,方便你看清楚 prompt 上下文到底改变了什么。

| 维度 | 不给上下文 | 给术语清单+背景 |

|---|---|---|

| 关键术语命中率 | 0/13 = 0% | 13/13 = 100% |

| Claude Opus 4.7 | Claude 四点七 | ✅ |

| Codex | Code X(断成两段) | ✅ |

| GPT-5.5 | GPT 5.5(丢连字符) | ✅ |

| huashu-design | 花书 Diffusion | ✅ |

| 29% / 22.1% | 百分之二十九 | ✅ |

| 字幕条数 | 72 条(碎) | 41 条(适合阅读) |

| SRT 时间戳格式合规 | 后段 5 处错(句点) | 全合规 |

| 总 token 成本 | 0.0101 元 | 0.0081 元(便宜 20%) |

最反直觉的是最后一行。带上下文的 prompt 多 1208 个 prompt token,你直觉以为更贵,但 completion 那一边模型不用瞎猜了,反而少 763 个 token。 多说一点话,让模型少说一点废话 。这是这次升级里第二个被吃掉的环节:模型瞎猜的成本。

Focus它在工作台里的位置

把这两个 demo 串起来看,论点其实很简单。

豆包 Seed 2.0 Lite 0428 不是来替换你正在用的 LLM 的。它的输出能力,写代码、复杂推理、长链路 Agent,肯定比不过 Claude Opus、GPT-5.5 这种旗舰。我也不会用它去写 1 万行代码。

但 输入这一侧 ,它提供的是 Claude Code、Cursor、Codex、OpenClaw 这一整代 coding agent 都没有的能力:让你直接把视频、音频、图片以和文本同等地位塞进同一个 API 调用,让 prompt 里的上下文直接作用在感知层。

这是「前置感官层」的意思,是它在你工作流里的位置:

视频/音频/截图 → [豆包 Seed 2.0 Lite 0428] → 结构化文本 → Claude Code / Codex / OpenClaw / Trae → 代码/文章

眼睛 + 耳朵

重点在这里:你不用换工作台。 日常用 Claude Code、Codex、龙虾 OpenClaw、Hermes Agent,或者字节自家的 Trae 都行——把豆包 Seed 2.0 Lite 当成前置感官接一层进去,你原来的工作流立刻就有了完整的眼睛和耳朵。不用迁移、不用学新工具,只是给现有的 coding agent 补上它原来缺的那部分感知。

这个月初我发了一本 Hermes Agent 的橙皮书,讲长链路 Agent 怎么把多步骤任务串起来。当时书里有一节专门讲 Agent 工作流的「输入侧瓶颈」:绝大多数任务卡在「怎么把现实世界的视频/音频/会议录屏喂给 Agent」这一步。

这本书写完之后我自己在工作流里也没真正解决这个问题,绕过去用 Whisper + 手动改字幕、用 Gemini 处理视频、用一堆胶水脚本拼。豆包 Seed 2.0 Lite 0428 是我看到的第一个用一次 API 调用就把这两件事都解决的全模态轻量模型。

价格也是这个论点的支撑。我只跟同档的全模态轻量模型对比,旗舰模型不是同一个段位,没必要拉进来。

| 模型 | 输入(元/Mtok) | 输出(元/Mtok) | 音频输入 |

|---|---|---|---|

| Doubao Seed 2.0 Lite | 0.6 | 3.6 | 9 元/Mtok |

| Gemini 3 Flash | 3.6 | 21.6 | 7.2 元/Mtok |

跟同尺寸的 Gemini 3 Flash 比,文本输入便宜 6 倍,输出便宜 6 倍。这个价格意味着你可以把它真的塞进生产链路,不只是做 demo。我那段 4 分 38 秒视频转字幕一次不到一分钱,意味着我每天录的几个视频片段全跑一遍语音识别也只要几毛钱。当成本低到「不用考虑成本」的时候,调用频率就会涨一个量级,工作流的形态会跟着变。

下一次开 Claude Code 的时候,你可以试着把那段不愿意手动转录的会议录屏丢给它了。

你也是时候给你的龙虾装上真正的耳朵和眼睛了。

来源:https://mp.weixin.qq.com/s/ZAAEQzBvziU6iqzyUpnXuw