在 Anthropic 的读心术之外,大模型黑盒迎来了真正的法医 Hao好聊论文

全文阅读

以下为编辑整理后的完整富文本内容。

在 Anthropic 的读心术之外,大模型黑盒迎来了真正的法医 | Hao好聊论文

腾讯前沿科技论文解读专栏,在代码与商业的交汇处,寻找AI的确定性。

文 |博阳

编辑|徐清阳

过去两年,如果你关注大模型的可解释性研究,你会发现一个现象,这个领域基本上是 Anthropic 一家在定义什么叫「进步」。

从 2023 年的 Toy Models of Superposition,到 2024 年的“金门大桥实验”,到 2026 年 4 月的情绪概念研究,再到最近 Anthropic 推出的 NLA(Natural Language Autoencoder,自然语言自编码器),让模型直接用人话解释自己脑子里在想什么。Anthropic 的方法论被当作行业标准在扩散。

但就在 Anthropic 这波新工具密集发布的同一个窗口,一家叫 Goodfire 的小公司四月底发了一篇论文《Interpreting Language Model Parameters》。

Goodfire 的创始人 Tom McGrath 是 Anthropic 和 DeepMind 可解释性团队的前成员。他从这个团队中走出来,转身走了一条不一样的路。

在他看来,可解释性的核心不在于去拆模型运行时产生的激活,而在于拆模型权重本身。

在这篇论文里,他们用一个叫 VPD(Verified Parameter Decomposition,对抗参数分解)的方法,把一个 67M 的小语言模型,拆成了几万个最小的、可以单独命名、可以单独修改的计算单元。

这篇文章我们就来聊聊这场在可解释性领域引发的「方法论之争」,以及它背后那个更大的问题。

大模型的黑箱,我们到底应该怎么打开它。

01

可解释性的三级台阶

要讲清楚 Goodfire 和 SAE 派在争什么,先得把可解释性这个领域的技术路线理清。粗略地讲,这两年有三条技术路线,你可以把它看作是三级台阶。

第一条路 · 找个能用的方向

最老、最朴素的一条路叫 Probing / Steering Vectors,翻译过来就是「线性探针」和「操纵向量」。它 2020 年前后就有。

用 Anthropic 的情绪向量论文做例子。他们让 Claude 写 100 种「挫败」主题的短故事,再让它写一堆中性的、跟情绪无关的短故事。然后分别把两堆故事喂进模型,提取某一层的激活向量。对「挫败」那组激活求平均,得到一个向量 A。对所有情绪的激活混在一起求平均,得到一个向量 B。A 减 B,得到的那个方向,就被认为是模型内部「挫败」相关的方向。

整个过程就是求均值、求差。两组故事在激活中的不同表现,就是「挫败」这个概念对应的方向。

拿到这个方向之后,Anthropic 把它直接加到模型推理时的激活里。加强版让模型变得更「挫败」,反向加就压下这种情绪。压一下「挫败」方向,reward hacking 行为下降;压一下「渴求赞许」方向,模型不再那么谄媚。

这条路的关键特征是,它并不声称自己找到了模型的真实内部结构,它只是找到了一些有用的方向。

第二条路 · 造一本能装下所有概念的字典

第二条路叫 SAE(Sparse Autoencoder,稀疏自编码器)。这是过去两年可解释性的主角,Anthropic 的金门大桥 Claude(就是通过SAE方法,找到Claude 3里象征金门大桥的具体激活特征)、《Towards Monosemanticity》、《Scaling Monosemanticity》等标志性论文都用的是它。

SAE 是一把更精细的工具。它不满足于找几个有用的方向,它想把激活空间里所有概念都一次性梳理出来。

模型在某一层产生一个 768 维的激活向量,这个向量混着几十个概念(名词、金融领域、首字母大写等等),全部挤在一起难以分辨。SAE 准备一本超大的概念字典(几万到几十万个词条,每个词条对应激活空间里的一个方向),然后说「给定任何激活,我都能找出最少的几个词条来近似还原它」。选出来的那些词条,就是当下激活的概念。

这个方法产出极高。Anthropic 用它在 Claude 3 上找到了上千万个「特征」,每一个都能被命名,「金门大桥特征」、「Python 代码特征」、「谄媚特征」。金门大桥 Claude 那种让模型对自己身份产生偏执的 demo,底层就是 SAE 找到「金门大桥」那个方向然后在输出中无限放大。前两天的 OpenAI 哥布林事件,也是 SAE 揭示的。

但 SAE 派这两年做的最雄心勃勃的事,不是「找特征」,是画电路图。

电路分析(circuit)的意思是找到 SAE 挖出来的多个特征之间的因果关系,然后串起来画出一张「信息流动图」。Anthropic 有个知名例子,模型处理「John and Mary went to the store. John gave a drink to」并预测下一个词 Mary 时,Anthropic 用 SAE 追到了里面的整条信息流,判断出某几层在识别名字,另几层在追踪谁被提过,最后几层做「选另一个」的操作。这三段特征串起来就是一个 circuit。

从野心上说,SAE circuit 已经超出了「给特征起名字」的层面,它在尝试回答「模型是怎么计算出它的结果的」。Anthropic 2025 年 3 月那篇对 circuit 解释最深入的论文,叫作《Biology of a Large Language Model》,标题就点明了,他们想做的事是给大模型写一本生物学教科书。

2026 年 5 月 7 日,Anthropic 又推出了一个叫 NLA 的新工具,你可以理解成「换了瓶颈材料的 SAE」。SAE 的瓶颈是一本稀疏特征字典,研究员还得对着字典里的特征猜功能;NLA 直接把瓶颈换成了自然语言。他们训练了一个翻译层让模型用人话说出「这个激活在想什么」,再用一个反向模块把这段人话还原回激活。这算是解决了 SAE「特征不好懂」的痛点,但它的还原能力不如 SAE。

第三条路 · 不研究运行时,直接拆机器本身

上面两条路都是激活路线,它们看的是模型在输出过程中激活的向量。第一条路解决「激活了什么概念」,第二条路更进一步,既要找全所有概念,还要画出概念之间怎么串起来完成计算。

但为什么还要走第三条更难的路?

因为 SAE 画的那张电路图,地基不够稳。

这里要引入一个 SAE 派自己内部早就发现的老问题,叫「特征分裂(feature splitting)」。Anthropic 2023 年就点过名。

你训一个 SAE,给它一本 4096 词条的字典,它找出 3800 个活跃特征,其中有一个对应「猫」。挺好。但你把字典扩大到 16384 词条呢?那个「猫」特征消失了。取而代之的是「白色的猫」、「黑色的猫」、「卡通猫」、「学术语境里提到的 feline」、「沙发上的猫」,十几个细碎的、上下文绑定的小特征。你再扩到 65536 词条?还会继续切碎这个现象意味着,你找到的「特征数量」,是被你字典大小决定的,不是被模型决定的。

打个生活化的比方。你让一个会计给你分账单。给他 4 个分类框,他告诉你「吃饭、交通、购物、娱乐」。给他 100 个分类框,他告诉你「周一午饭、周二午饭、周三午饭、地铁、打车、网约车……」。给他 1000 个框,他继续切。你不会觉得他发现了你真实的消费结构,而是被分类框的数量牵着鼻子走。

特征分裂对 circuit 分析的杀伤力尤其大。circuit 是建立在特征上的,你画出来的那张图,每一个节点都是一个 SAE 特征。如果特征本身会因字典大小而切碎、重组、漂移,那整张电路图也会跟着不稳定。你换一本字典重新跑,可能得到一张完全不同的电路图,但模型本身没变,变的只是你测量时用的那把尺子。

这就是 Goodfire 真正要挑战的东西。不是「SAE 找的特征没意义」,而是「SAE 的特征作为可解释性的基本砖块,稳定性不够,撑不起『模型真实电路』这个承诺」。VPD 的逻辑就是,那我们换一种砖。不用激活做砖,用权重做砖。

用一个生物学的类比可以直接感受到这两条路的差别。SAE 那一派做的事,像是功能核磁共振加脑电图。给被试看图片,观察哪块脑区在亮、活动怎么传播。你可以画出一张功能图谱,但你看到的是脑的活动,不是脑的物理构造。如果有一天你想问「这个神经元具体连到哪里」、「这根神经纤维是怎么走的」,MRI 给不了答案。VPD 走的是神经解剖学,直接打开大脑,看神经纤维怎么排、突触怎么连。辛苦、分辨率有限,但看到的是物理构造本身。

这两件事互相补充,不替代。问题是 SAE 这一派这两年慢慢把自己的定位拔高到了「我能做神经解剖」的程度,Goodfire 这篇论文就是一次温和但坚定的纠偏,你们做的是功能 MRI,真正的解剖得这么做。

02

逆向雕刻的两次折戟与 VPD 的破局

要理解接下来的技术突破,我们必须先看懂大模型可解释性的标准流水线。要把几千亿参数的黑盒翻译成人类能读懂的图纸,整个工程本质上就是一个「提取器」的运作过程。这套流水线由三个核心组件构成。

第一个组件是终极产物,字典(Dictionary)。大模型的原始状态是一坨混沌的数字(权重矩阵),而字典是我们强行将其拆解后得到的一张概念对照表。字典里的每一个词条,对应着模型内部一根极其微小的、不可再分的物理齿轮(秩 1 分量)。

在 SAE 中,这本字典里的词条是概念。但在 VPD 里,这个字典里的词条绝大部分并不是「猫」或「红色」这种清晰的概念,而是一种冷冰冰的机械动作。比如「当遇到前置虚词时开启占位槽」。VPD 一开始想找的就是模型参数的运作机理,而非概念,所以它产出的字典更接近一本「机械操作手册」而非「词汇词典」。

第二个组件是核心动作,拆解与激活(Decomposition & Activation)。怎么把混沌的矩阵变成清晰的字典?必须在数据流动时进行。

我们让海量的数据流穿过大模型,同时用外挂的算法模块,强行把模型权重拆成几万个小齿轮。当文本流过时,如果某个词(比如「橘猫」)让其中一个齿轮通电亮起,这就叫激活。我们通过监控这些齿轮何时亮起、亮得多强,来反推它代表什么。

第三个组件是质检机制,消融(Ablation)。拆出来的字典到底保不保真?必须做极其暴力的破坏性测试。

消融的本质就是「拔电源」。当模型正在处理「橘猫」并准备预测下一个词时,我们强行把字典里那个疑似代表「猫」的齿轮拔掉(对应权重归零)。如果模型瞬间变傻,再也输出不了与猫相关的词,就证明这根齿轮确实是模型理解「猫」的物理刚需。

明白了这个框架,我们才能看懂参数路线过去面临的绝境。

2024 年的 APD 败在质检信号太嘈杂。APD 甚至还没用上消融,它用的是「归因」(算贡献度)。它试图看着流过电路的数据,去算这根电路对最终结果有多大功劳。但大模型内部太复杂,同一根「苹果」电路在「吃苹果」和「苹果手机」语境里算出来的功劳上蹿下跳。质检信号全是噪音,训练直接崩溃。

2025 年的 SPD 终于引入了消融,但又栽在两个细节上。一是消融策略太温柔,「闭着眼睛随机拔几根电源」式的抽查,根本测不出那些只在罕见、刁钻语境下起作用的隐藏电路。二是惩罚标准跟 SAE 一样只盯激活宽度,于是把特征分裂的毛病也一并继承了过来。

所以参数路线一度被悲观地认为是「方向绝对正确,但工程上不可能做出来」。

直到 2026 年 4 月,Goodfire 发布 VPD,做对了 SPD 没做对的两件关键决策。

第一战,对抗消融

假设机器内部有一根疑似代表猫的核心齿轮。SPD 的随机质检抽到了一段极其丰富的上下文,「我听到了一声喵喵叫,接着一只橘色的小动物跳上了桌子」。此时把代表猫的齿轮电源拔掉,机器会变傻吗?大概率不会。

因为在这段丰富的上下文里,除了核心齿轮,还同时亮起了喵喵叫、橘色、小动物、跳跃等一堆相关齿轮。当猫这个齿轮缺席时,这些边缘齿轮产生了一种极其狡猾的「代偿效应」。它们组合在一起把缺失的语义补了回来,让模型依然能猜出下一个词。SPD 的质检系统一看,拔了这根齿轮机器照样运转如飞,于是得出错误结论,这根齿轮是冗余废铁,删掉。

既然机器喜欢用其他词汇组合来打掩护,VPD 就必须打破这种掩护。

对抗消融的硬核之处,就在于它不是在海量随机数据里瞎猫碰死耗子,而是通过梯度的反向传播进行反向算计。在拔掉某根齿轮之前,算法先反推,我要拼凑出怎样一种极其刁钻的上下文,才能让其他所有起掩护作用的齿轮全都熄火,让大模型只能孤零零地、百分之百地依赖这一根齿轮?

比如对那根代表猫的齿轮,对抗算法可能强行构造出一个类似「Feline entity」这样极其枯燥、剥离了所有动作和颜色暗示的干瘪输入。在这个极端组合下,喵喵叫、橘色等掩护齿轮全都没法触发,那根待测的核心齿轮被彻底孤立。这一瞬间再暴力拔掉它的电源,如果机器瞬间崩溃,就拿到了铁证,这根齿轮是不可替代的底层核心,有资格被写入物理字典。

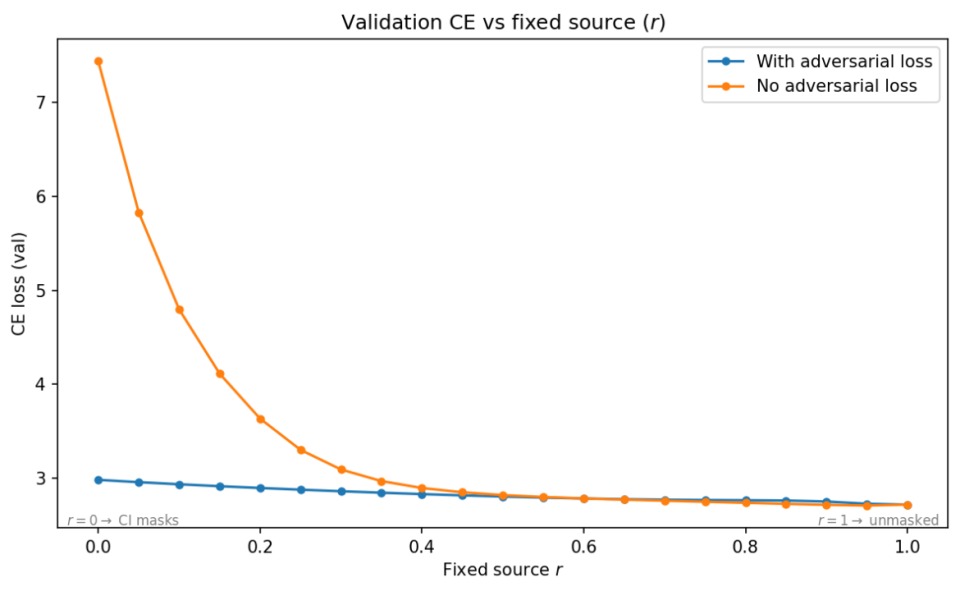

图:对抗消融 vs 随机消融的效果对比

在 VPD 的精准手术下,研究员可以直接剔除掉模型内部超过八成被判定为冗余的参数容量。仅仅依靠保留下来的核心齿轮重建多层网络,最终测得的 KL 散度依然保持极低,输出性能与原模型几乎完全无损。

- 图:剔除八成参数容量后,KL 散度依然保持极低 *

第二战,频率最小化

VPD 做对的第二件事,是直接朝着 SAE 两年来束手无策的特征分裂开刀。武器叫「频率最小化」。

要理解这个武器,需要区分两个常被混为一谈的统计量,激活宽度与激活频次。

激活宽度指的是一股数据流在瞬间同时点亮了几个特征。模型读到「白色的猫」,同时激活「白色」和「猫」,宽度是 2。激活频次指的是某个特征在整个训练数据集里总共被点亮多少次。「猫」在十万个 token 里被点亮 800 次,频次就是 800。

SAE 的核心损失函数里,只对激活宽度进行惩罚,完全不惩罚激活频次。这正是一切特征分裂的罪魁祸首。

算一笔账。字典里存「猫」有两种方式。方式 A 保留一个宽泛的「猫齿轮」,处理「白色的猫」时同时启动「白色」齿轮,宽度为 2。方式 B 切分出十个具体的「碎猫特征」,「白色的猫」占一个,「黑色的猫」占一个,每次只需点亮一个特化影子,宽度为 1。SAE 一算账,方式 B 代价更小,于是主动推着模型选择 B。

VPD 的频率最小化在损失函数里强行加入了一项「建档税」,对字典里每个齿轮的总使用频次进行非线性惩罚。关键就在「非线性」。它不是按次累加收费,而是任何一个齿轮只要敢在字典里建档使用,第一笔「基础开机费」极其高昂,但后续重复使用的边际成本迅速递减。

按这个算法,开一万家零售店的固定成本远远大过一家批发超市。模型乖乖把切碎的影子重新合并,去复用那个宽泛且坚实的「猫齿轮」。

为了验证特征分裂是否被有效遏制,研究员把分解工具的字典容量设置为基础值的 0.5 倍、1 倍、2 倍、4 倍,整体容量拉大了 8 倍。结果,属于 SAE 家族的 PLT/CLT 方法给多少容量就乖乖填满多少。而 VPD 的表现像一块顽石,容量 0.5 倍时活跃分量是 6500 个,拉大到 4 倍依然死死钉在 6500 到 7000 之间。

- 图:容量扫描图。SAE 家族(PLT/CLT)给多少容量填多少,VPD 的活跃分量数钉死在 6500 左右 *

容量翻了 8 倍,活跃分量数纹丝不动。这说明 VPD 找到的分量数量是由机器固化的物理结构决定的,与测量工具完全解绑。这台机器真实使用的核心齿轮就是大约 6500 到 7000 个。

03

被看见的机器内脏

容量扫描图确立了齿轮的物理真实性,但这仅仅是入场券。这本物理字典里那几千个实体齿轮究竟在执行什么样的计算?流水线走到了最深处,让我们第一次清晰目睹机器内部的咬合机制。

注意力头不是各干各的

在 Transformer 架构里,每一层都分布着多个注意力头。你可以把它们理解为机器表面的多个独立探照灯,每个探照灯决定当前应该关注上下文里的哪些词汇。主流观点普遍采取最简单的假设,一个探照灯专门干一件事。某个头叫「关注前一词汇头」,另一个叫「归纳头」。

VPD 发现这个假说并不成立。

VPD 在拆解注意力机制时,从极深处拔出了一对特定的齿轮,编号 q316 和 k329。这对齿轮的核心职能非常明确,就是强迫模型去关注「前一个词汇」。但它们并没有被塞进某一个特定的注意力头里,而是同时均匀分布在全部 6 个注意力头里。当你通过消融强行切除这对齿轮时,所有 6 个注意力头的「看前一词」行为瞬间集体熄火。

这意味着这根本不是某一个单打独斗的探照灯在独立工作,而是一对底层齿轮跨越 6 个头进行分布式传动的结果。你砸碎表面任意一个探照灯毫无用处,剩下 5 个依然在执行任务;但抽掉底层这对齿轮,6 个头会同时瘫痪。这彻底颠覆了「一个零件对应一个功能」的直觉,模型内部的机制是跨越宏观结构的分布式协同。

- 图:关注前一词齿轮在 6 个注意力头上的均匀分布 *

模型自己长出了语法

第二个案例直抵语言学深处。

英语语法对 it 这个词有一个极其苛刻的经典区分。第一种是实指代词,如 the book is heavy, it weighs five pounds , it 有明确的实体指向。第二种是纯粹的虚词主语(dummy subject),如 it is raining , it 没有任何实质意义,纯粹是因为英语句法强制要求必须具备主语而塞进去的结构占位符。 there is a cat 中的 there 同理。

这是语言学家钻研多年的知识结晶。核心悬念是,大模型在没有人类显式灌输语法规则的情况下,能自己长出这种判别能力吗?

VPD 提取出了这组判别齿轮。一个名为 q308 的查询齿轮,仅仅在数据流滑过系动词( is 、 was 、 seems )时通电,并且有一个绝对前提,前面出现的词必须是 it 、 there 或 here 。如果是 she is 或 they are 这种实指代词与系动词的组合,q308 死一般沉寂。q308 还与专门在 it 上通电的 k218,以及在 there/here/it 上通电的 k485 紧密咬合,三个齿轮构成一个机械语法判别器,前置卡槽必须是「虚词标记」,当前卡槽必须是「系动词」,两个条件同时满足才会触发。

- 图:q308/k218/k485 三齿轮咬合机制的激活样本 *

大模型在黑箱深处,用几个微小齿轮的精妙咬合重现了人类花几十年时间总结的语法法则。这种深度的机械解剖,是仅仅依靠激活去捕获影子的路线绝对做不到的。单看激活,你最多知道「这里飘过了一个虚词概念的影子」,但永远无法回答「这个判断到底是由哪三个具体的物理齿轮卡在一起算出来的」。

04

从外围观测器到深层手术刀

VPD 真正的价值不在技术本身,而在于它彻底重新定义了可解释性的终极意义,可解释性终于可以反过来对模型本体做外科手术了。

传统的特征操纵(Steering),比如 Anthropic 那 171 个情绪向量,操作的全部是数据流经过瞬间的影子。你给数据流注入一剂「消除挫败」的干预药水,当次推理的输出立刻改变,但模型本身的物理结构纹丝未动。换一个新输入,你还得重新打针。这台机器的实体构造里永远不会留下你干预过的痕迹。

VPD 拿着验证过的物理字典,可以直接拧紧或拆除某个实体齿轮,改动永久固化在机器里。这种「底层下刀」在工程上意味着三件具体的事。

第一,能力的物理移除而非话术抑制。RLHF 训出来的安全对齐,本质是教会模型在某些场景下「不说」,但底层的能力齿轮还在,只是被压制了。这也是越狱攻击屡禁不止的根因,能力还在,话术绕过去就行。VPD 路线的对齐是直接把支持有害行为的物理齿轮拆掉,能力从模型里物理消失。这跟 RLHF 的差别,类似于「让一个会做炸弹的人保证不做」和「让他失去做炸弹的知识」的差别。

第二,可被审计的因果链。SAE 的 circuit 给你看的是「这条信息流经过了哪些激活」,每次重测可能漂移。VPD 的电路图是建立在固化齿轮上的,这意味着你可以对一个已经发生的模型行为做「事后法医」,精确指出是哪几根齿轮在哪一步咬合产生了这个输出。这对幻觉追责、安全事故复盘是质变。

第三,模型的可缝合编辑。VPD 论文里那个剔除超过八成参数容量、KL 散度依然极低的实验,本质上证明了模型的核心齿轮可以被精确识别和剥离。这意味着未来的模型微调可能不再是端到端梯度下降,而是「识别坏齿轮 → 替换 → 再缝合」的外科操作。

VPD 牺牲了人类语言的通俗可读性,你可能无法用自然语言完美定义某根齿轮,但换来的是对机器彻底的物理调整权。这不是诊断工具的更新,是一种全新的、面向实体对象的大模型物理表示法。

05

炼金术的黄昏

VPD 不是孤立的一篇论文,它是这一波「AI 科学化」运动里的一颗信号弹。

过去十年的 AI 有个奇怪处境,工程进展遥遥领先于科学解释。Scaling law 是经验拟合,涌现是事后命名,RLHF 调参靠手感。你知道这么干有效,但说不清楚为什么。这跟化学诞生之前的炼金术没有本质区别。

- 图:VPD 子组件的内部完备性远高于 SAE 家族方法 *

但最近一年,几条原本各走各的研究支线开始朝同一个方向收敛。

可解释性在物理化。从 SAE 贴标签到 VPD 拆齿轮,这门学科第一次开始尝试回答「模型的基本单元是什么」,对应的是化学史上从四元素说走到元素周期表的那一步。

训练动力学在物理化。刘子鸣团队 2025 年的《Neural Thermodynamic Laws》把 LLM 训练过程与经典热力学做了严密的数学对应,grokking、loss spike、规模涌现这些现象,第一次有了被还原成物理规律的可能。

深度学习自身也在喊出理论化宣言。2026 年 4 月,Jamie Simon、Arthur Jacot 等 14 位研究者联名发表《There Will Be a Scientific Theory of Deep Learning》,主张这门学科已经积累了足够多的「解析可解场景」和「跨任务普适现象」,值得被沉淀成一门真正的理论。

三条线合起来做的是同一件事,给 AI 找基本单元,找量化规律,找机制框架。化学走出炼金术靠的是这三件套,生物学走出博物学也靠这三件套。今天的 AI 第一次有希望同时补齐。

等这件事走通,「涌现」会从浪漫描述变成可推导的相变,「对齐」会从训练话术变成工程指标,「幻觉」会从概率失误变成可定位的元件故障。一门学科的核心词汇从经验描述锐化成机制法则的那一刻,才是它真正成熟的一刻。

我们大概正站在转折点上。回头看,今天的我们可能会被记住为最后一代仅凭经验和直觉就能让模型涌现智能的人。

再往后,靠的就是科学。

来源:https://mp.weixin.qq.com/s/q9jrUoIl79TG88Xy4Prdeg